RoboX Chrome Extension

HTTP Statuscode, Meta-Robots-Tag, X-Robots-Header, Canonical, robots.txt und verlinkte Sitemaps direkt beim Seitenaufruf validieren. Clever prüfen, schneller handeln.

Was ist RoboX?

RoboX ist eine von uns entwickelte Chrome Extension, die technische SEO-Analysen direkt in Deinem Browser vereinfacht. RoboX kombiniert die Prüfung von HTTP-Statuscodes (inkl. Redirects), Canonicals, Meta-Robots-Tags, X-Robots-Tags und der robots.txt in einer zentralen Oberfläche. Das Tool bewertet in Echtzeit, ob eine URL erreichbar, für Suchmaschinen zugänglich (Crawlability) und indexierbar (Indexability) ist.

HTTP-Status inkl. Redirect-Ketten

Oft verbergen sich SEO-Probleme tiefer in der Server-Kommunikation. RoboX deckt sie auf:

- Redirect-Inspektor: Verfolgt die komplette Weiterleitungskette Deines aktuellen Seitenaufrufs und dokumentiert den Statuscode für jeden einzelnen Hop.

- Robots.txt Block-Erkennung: Warnt Dich sofort, wenn eine Zwischen-URL in einer Weiterleitungskette per robots.txt gesperrt ist und Crawler dort abbrechen würden.

- Raw HTTP Header: Gibt Dir direkten Einblick in die echten Response-Header für jeden einzelnen Weiterleitungsschritt.

Meta-Tags & X-Robots-Tag

Viele SEO-Fehler bleiben unentdeckt, weil Anweisungen im Hintergrund überschrieben werden. RoboX löst dieses Problem durch eine duale Analyse:

- Parallele Prüfung: Das Tool liest gleichzeitig den Meta-Robots-Tag im HTML als auch den X-Robots-Tag im HTTP-Response-Header aus.

- Konflikt-Erkennung: RoboX warnt Dich sofort, wenn sich HTML und Header widersprechen (z. B. wenn das HTML "Index" signalisiert, der Header aber "Noindex" erzwingt).

- JavaScript-Manipulation: Es erkennt und warnt Dich, wenn JavaScript die Meta-Werte nach dem initialen Laden der Seite abändert.

Canonical inkl. Deep-Check

Canonicals sind für die Suchmaschinen essenziell, um Duplicate Content zu vermeiden. RoboX bietet hierfür eine tiefgehende Prüfung:

- Duale Analyse: Analysiert HTML- und HTTP-Header-Canonicals auf Abweichungen und deckt Konflikte direkt auf.

- Canonical Deep-Check: Ermöglicht per Klick eine Detail-Prüfung der fremden Canonical-Ziel-URL (Statuscode, robots.txt, Indexierbarkeit), ohne die aktuelle Seite verlassen zu müssen.

Robots.txt inkl. Syntax Validierung & URL Tester

Die robots.txt ist das wichtigste Werkzeug zur Steuerung des Crawlings. RoboX liefert Dir hierfür tiefgehende Prüfmechanismen und Test-Tools:

- Strikte Validierung (RFC 9309): Die robots.txt wird nach offiziellem Standard auf Syntax-Fehler, kritische Probleme und veraltete Direktiven geprüft. Das Tool zeigt Dir exakt an, welche Code-Zeile die aktuelle URL blockiert.

- Abweichende Bot-Anweisungen: RoboX erkennt sofort, ob für spezifische User-Agents (wie den Googlebot, Bingbot oder KI-Crawler wie den GPTBot) abweichende Regeln im Vergleich zum Standard-Wildcard (*) existieren.

- Path Simulator: Über ein integriertes Eingabefeld kannst Du beliebige URLs oder Verzeichnisse der aktuellen Domain testen und simulieren, ob ein bestimmter Crawler Zugriff hätte, ohne die Seite physisch aufrufen zu müssen.

XML Sitemap Validator

Oft liegen Sitemaps ungenutzt oder fehlerhaft auf dem Server. RoboX bietet einen initialen Check für die Sitemaps, die in der robots.txt hinterlegt sind:

- Auto-Erkennung: Sitemaps, die in der robots.txt verlinkt sind, werden automatisch aufgelistet und können mit einem Klick validiert werden.

- Sitemap-Validierung: Die Sitemap wird auf inhaltliche und strukturelle Fehler geprüft, wie z. B. ungültige W3C-Datumsformate, fehlende Pflicht-Tags (<loc>), fehlerhafte hreflang-Attribute und unzulässige XML-Knoten. Das Tool entpackt komprimierte .gz-Sitemaps dabei nativ.

Wichtiger Hinweis zur Sitemap-Prüfung:

Da die Validierung clientseitig im Browser stattfindet, ist sie aus Performance-Gründen begrenzt. Das Tool entpackt komprimierte .gz-Sitemaps zwar nativ, aber bei extrem großen Sitemaps (über 10.000 URLs) kann der Arbeitsspeicher (RAM) stark beansprucht werden. Für tiefergehende, groß angelegte Sitemap-Audits empfehlen wir andere Tools. Sprich uns dazu gerne an, wir helfen Dir dabei weiter!

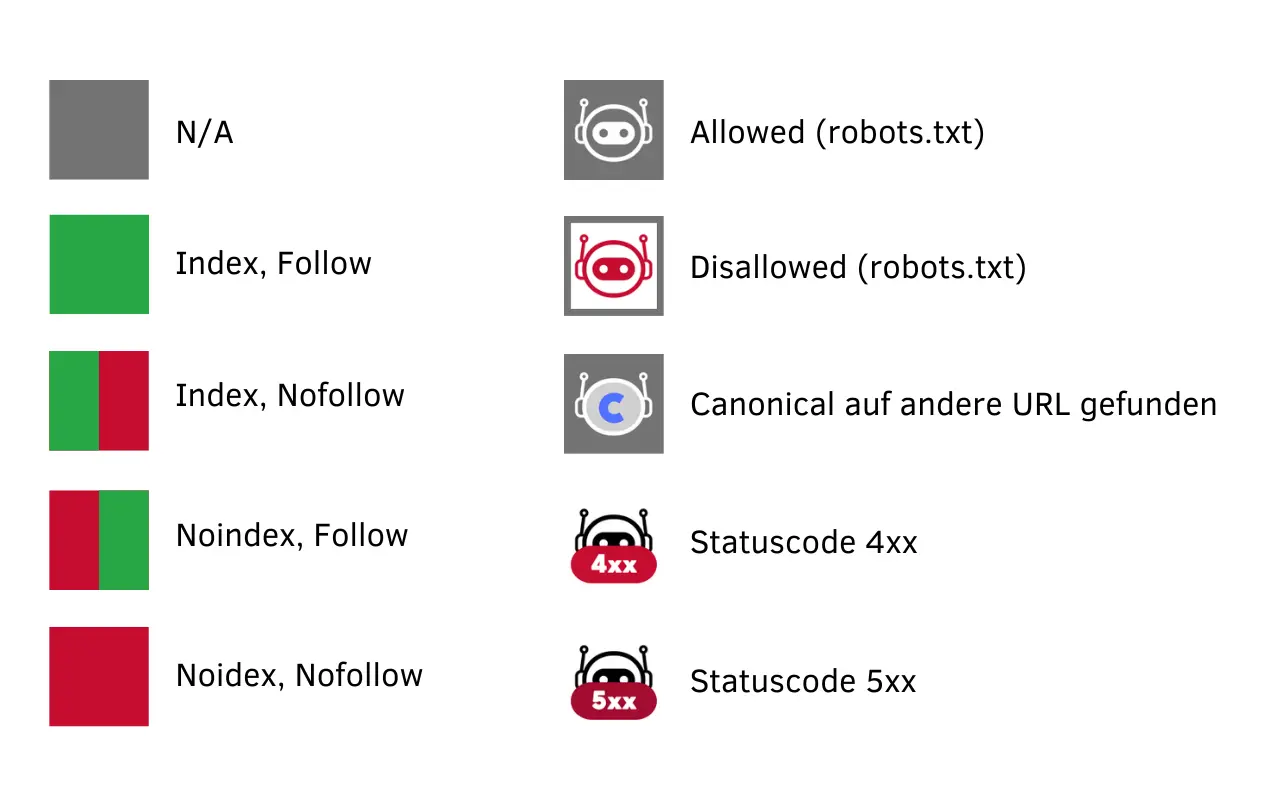

Auf einen Blick: Die RoboX Icon-Logik

Das Extension-Icon in Deiner Browser-Leiste ist dynamisch und verrät Dir den wichtigsten SEO-Status der URL in Echtzeit, ohne dass Du das Popup öffnen musst. Hier erkennst Du auf einen Blick den Status quo der Website: Die Hintergrundfarbe signalisiert die Indexierung (Meta Robots, X-Robots-Tag, Canonical), während das Bot-Symbol im Vordergrund Dir den Status zum Crawling (robots.txt Erreichbarkeit) und kritischen Fehlern (Statuscodes) zeigt.

Individuelle Einstellungen: Workflows, UI & Datenschutz

RoboX ist hochgradig anpassbar und so konzipiert, dass es sich nahtlos in Deinen Arbeitsalltag einfügt:

- On-Demand vs. Live-Monitoring: In den Optionen kannst Du festlegen, ob RoboX die Hintergrund-Checks bei jedem Seitenaufruf (für den Live-Icon-Status) durchführt, oder ob die Analyse ressourcenschonend erst beim aktiven Öffnen des Popups starten soll.

- Dynamische Error-Icons: Entscheide selbst, ob spezifische 4xx- und 5xx-Fehler-Icons direkt in der Browser-Toolbar angezeigt werden sollen oder nicht.

- Individualisierbare UI & Dark Mode: Deaktiviere nicht benötigte Sektionen, wechsle fließend zwischen Dark- und Light-Mode oder stelle die Sprache der Extension (Deutsch/Englisch) ein.

- SPA Support: Erkennt Single Page Applications (SPAs) und fordert zur Aktualisierung auf, damit Deine angezeigten Header-Daten nie veraltet sind.

- Das Snapshot Overlay: Mit einem Klick kannst Du das Popup-Fenster der Extension in ein schwebendes Overlay verwandeln, das direkt über der Webseite liegt. Ideal, um die SEO-Daten bei der weiteren Navigation im Blick zu behalten oder für Präsentationen im Screen-Sharing.

- 100% Client-Side (Privacy First): RoboX arbeitet vollständig lokal in Deinem Browser. Es werden keine Tracking-Daten, Browserverläufe oder analysierten Inhalte an externe Server gesendet. Die Extension verbindet sich ausschließlich mit den URLs, die für Deinen aktuellen Seitenaufruf relevant sind (inklusive Redirect-Hops und Canonicals), um technische Dateien wie die robots.txt abzurufen.

Installation

RoboX ist kostenlos und direkt über den offiziellen Chrome Web Store verfügbar.

So fügst Du RoboX hinzu:

- Öffne den Eintrag im Chrome Web Store

- Klicke auf "Hinzufügen".

- Pinne das RoboX-Icon in Deiner Browserleiste an, um das Tool immer griffbereit zu haben.

- Gehe mit der rechten Maustaste auf das RoboX-Icon, klicke auf “Options” und entscheide, ob das Tool Dir live den Status von aufgerufenen URLs anzeigen soll oder nur bei einem Klick auf das Icon.

- Rufe eine beliebige Webseite auf und klicke auf das Icon für mehr Details zur Crawl- und Indexierbarkeit der aufgerufenen URL und um die robots.txt und Sitemaps validieren zu lassen.